近日,安徽大学互联网学院贾兆红教授、徐凯副教授课题组在遥感智能解译方面取得重要进展,先后有两篇研究成果被遥感领域国际顶级期刊IEEE Transactions on Geoscience and Remote Sensing在线发表,一篇研究成果被地理信息领域顶级期刊Geospatial Information Science期刊在线发表。

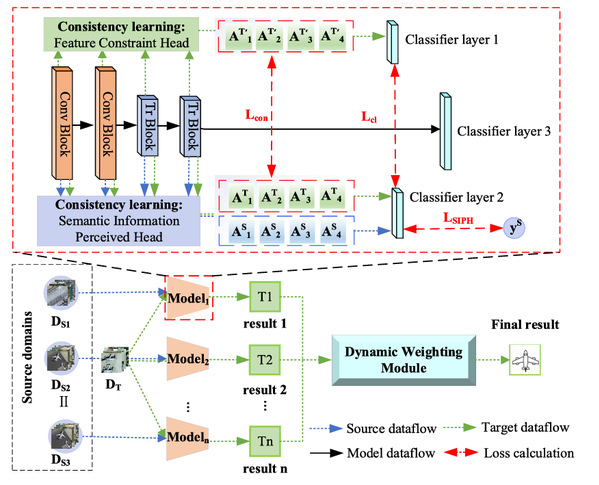

论文“Enhancing Remote Sensing Scene Classification With Hy-MSDA: A Hybrid CNN–Transformer for Multisource Domain Adaptation”(doi: 10.1109/TGRS.2024.3516522)聚焦于遥感图像场景分类中的域偏移问题,尤其是在目标域缺乏标签数据的情况下,提出了一种创新性方法——Hy-MSDA。该方法结合CNN和Transformer,旨在实现高效的多源无监督领域自适应(MUDA)。Hy-MSDA设计了两个关键模块:一致性学习模块和动态加权策略,分别在特征层和决策层实现跨域对齐优化。在特征层,一致性学习模块确保从多个源域中提取一致的域不变特征,同时保留丰富的全局语义信息;在决策层,动态加权策略依据源域贡献度进行自适应加权调整,从而最大化目标域的分类精度。这两个模块相辅相成,显著提升了多源领域自适应任务的表现。实验结果表明,Hy-MSDA在多个遥感数据集上的分类精度提升了2%–7%,并在遥感图像分割任务中展现出与监督方法相当的优异表现。该方法为解决遥感图像领域的域偏移问题提供了全新思路,具有广泛的应用价值。

图1 Hy-MSDA方法框架图

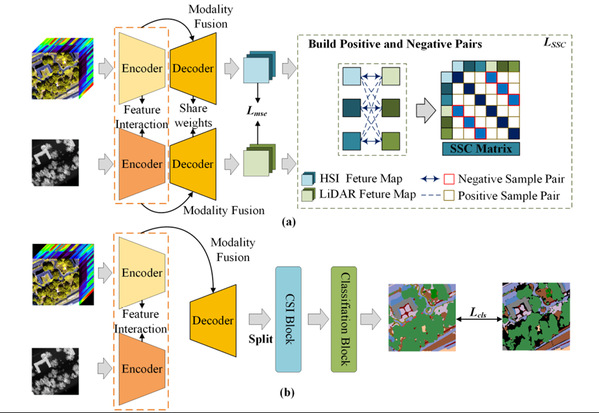

论文“A Contrastive Learning Enhanced Adaptive Multimodal Fusion Network for Hyperspectral and LiDAR Data Classification”(doi: 10.1109/TGRS.2024.3521960)聚焦于高光谱图像与激光雷达图像的多模态融合分类问题,尤其是在标注数据稀缺的条件下,提出了一种创新性模型——CAMFNet。CAMFNet采用对比学习策略和层次融合策略,通过双分支网络实现高效的多模态数据交互与融合。针对标注数据成本高的问题,模型引入了语义相似性对比损失,从无标签数据中学习多模态特征,实现跨模态语义对齐,充分挖掘未标注数据的潜力。在特征融合方面,设计了跨模态特征交互融合模块,利用自适应权重分配机制对光谱-空间和高程特征进行精细融合。此外,还开发了通道分割与整合模块,进一步整合多模态融合特征,提升深层次融合效果。实验结果显示,CAMFNet在多个公开高光谱-激光雷达遥感数据集上取得了领先的分类精度,尤其在训练样本较少的情况下表现尤为突出。该研究为多模态遥感图像协同分类提供了一种创新性解决方案,展示了良好的应用前景。

图2 CAMFNet方法框架图

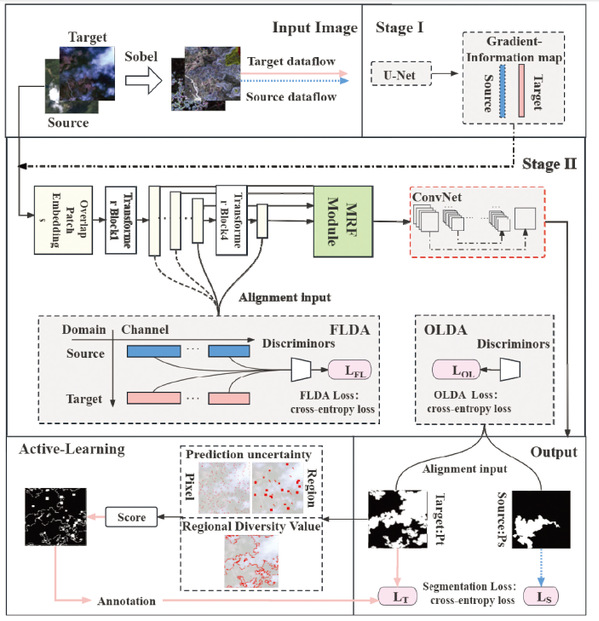

论文“ADAC: An Active Domain Adaptive Network with Progressive Learning Strategy for Cloud Detection of Remote Sensing Imagery”(doi: 10.1080/10095020.2024.2389958)聚焦于提升遥感卫星云检测模型在不同遥感卫星数据域中的适应性与应用能力,论文提出了一种主动领域自适应网络ADAC,该网络通过引入主动学习策略,选择少量具有代表性的样本进行标注,从而有效地将源域训练模型迁移到目标域。与完全无标记的目标域训练策略相比,ADAC更加实用,能够以少量标记样本实现显著的迁移效果。同时,针对复杂云场景的检测挑战,创新性地设计了云分割生成器网络G,采用渐进式学习策略,将网络训练分为两个阶段:通过学习梯度信息指导云边界的精准分割,并有效区分云与云状物体。G网络融合了Transformer和卷积神经网络CNN的特性,以解决薄云误分类的难题,从而进一步提升检测性能。实验在Sentinel-2、Landsat 8、GF-2多个数据集上进行了验证,结果表明,在目标域仅标注5%训练样本的情况下,ADAC实现了目标域总体精度提升4%的效果,展现了出色的迁移适应性能,为遥感图像云检测提供了一种高效且可靠的解决方案。

图3 ADAC方法框架图

新闻链接:https://www.ahu.edu.cn/2024/1225/c15129a355176/page.htm

网站内容来源于互联网,由网络编辑负责审查,目的在于传递信息,提供专业服务,不代表本网站平台赞同其观点和对其真实性负责。如因内容、版权问题存在异议的,请与我们取得联系,我们将协调给予处理(按照法规支付稿费或删除),联系方式:ahos@aiofm.ac.cn 。网站平台将加强监控与审核,一旦发现违反规定的内容,按国家法规处理,处理时间不超过24小时